Sam Altman, el creador del ChatGPT, ha estado en Madrid y se ha entrevistado con el presidente del gobierno. Lo ha hecho para intervenir en una mesa redonda celebrada en la IE University.

En el transcurso de su viaje, han formulado declaraciones muy contundentes sobre los riesgos de la IA . En concreto, además de asegurar que es la tecnología más poderosa que la humanidad haya visto nunca, ha apuntado que sus efectos pueden ser «catastróficos» . «Con la IA hay que tener el mismo cuidado que con un arma nuclear». Y en este sentido, pide la creación de una entidad internacional similar al Organismo Internacional de la Energía Atómica de la ONU para controlar esta tecnología.

Cabe recordar que Altman ha sido criticado por numerosos científicos y expertos por poner la IA en manos del usuario corriente, a pesar de que la tecnología es imperfecta y presenta sesgos que pueden desinformar. Por tanto, quien denuncia es a la vez denunciado por poco responsable.

Pero, ¿cuál es la dimensión real del problema? Las dos IA más extendidas en ese momento, Gemini además del ChatGPT, contestan a la cuestión sobre la amenaza que significa para la sociedad.

Su respuesta puede resumirse en estos puntos:

- Pérdida de control y toma de decisiones autónomas. Algunos expertos creen que la IA, que se educa a sí misma, puede llegar a ser tan sofisticada que supere el control humano y tome decisiones por su cuenta que podrían tener consecuencias terribles en todos los ámbitos en los que ella opera, que ya son prácticamente todos aquellos que tienen significación cultural, militar, política o económica.

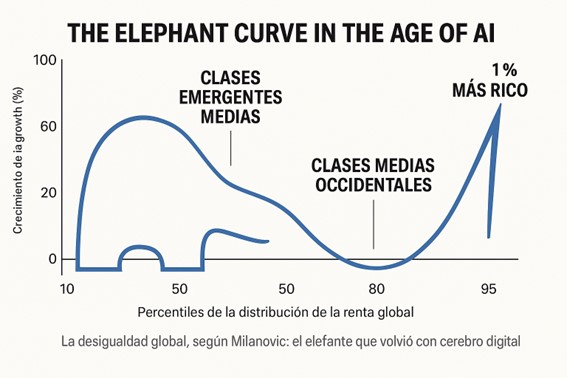

- Paro masivo y crecimiento de la desigualdad social. La IA puede generar un paro masivo aunque en esta cuestión no se pongan de acuerdo, porque al mismo tiempo se considera que dará lugar a nuevos puestos de trabajo. En todo caso lo que parece claro es que entre el proceso de destrucción y creación no habrá sincronía y que, por tanto, el problema estará ahí, lo que hay que ver es si su magnitud es sólo crítica o catastrófica. Se considera que serán los trabajos repetitivos y rutinarios los más afectados, pero hay otros muchos que no responden a estas características y que también recibirán el impacto. En el ámbito del derecho, en todo lo referente a la documentación, tratamiento de datos, elaboración de síntesis, tareas de análisis financiero. Siempre acabará existiendo un receptor humano, pero moldes de las tareas intermedias que ahora llevan a cabo titulados universitarios, desaparecerán. Este hecho y la ganancia que provoque a los mayores niveles profesionales y empresariales aumentará la desigualdad, que sólo es un fenómeno que se va acentuando a lo largo del presente siglo.

- Manipulación y control social. Es evidente que la IA puede utilizarse para manipular a la opinión pública, no sólo desde el punto de vista del texto sino de la imagen, de la imitación de la voz, de crear personajes que reproducen lo real para hacerle decir lo que quieran. Hace poco el arzobispo de Urgell y copríncipe de Andorra, vio cómo una grabación suya recomendando unas determinadas inversiones aparecía en la red. Todo era un montaje realizado con la ayuda de la IA. También gobiernos y empresas pueden utilizarlo para influir en las elecciones. De hecho, ya lo están haciendo, y de la misma forma pueden promover agendas específicas. Nunca ha habido tantas posibilidades de manipular a la opinión pública.

- Invasión de la privacidad y vigilancia masiva. Los propios usuarios de la IA lo facilitan interactuando con ella, pero es que además todas las grandes empresas tecnológicas, empezando por Amazon, disponen de una información brutal sobre los usuarios, que sumado al uso del potencial de la IA puede representar la desaparición de la privacidad. También facilita las prácticas de vigilancia masiva y, por tanto, la degradación de las libertades civiles.

- Armas autónomas. El uso de la IA en la guerra, que ya se está aplicando con sistemas de armamento que pueden operar sin intervención humana directa, puede dar lugar a situaciones de descontrol que se multiplicarían cuando los terroristas accedieran a estas tecnologías.

- Discriminación. Son numerosos los casos en los que los algoritmos que aplica la IA acentúan los sesgos iniciales de los datos que han sido entregados, provocando un aumento de la discriminación hacia determinados grupos sociales.

- Quiebras y errores. La IA comete numerosos errores o incluso engaña o se autoengaña inventándose respuestas a lo que no conoce. Por ejemplo, para el ChatGPT Jordi Pujol, el que fue durante muchos años presidente de la Generalitat de Cataluña, está muerto y además ha pasado por prisión. Estos errores si se producen en el ámbito de la atención médica, de la infraestructura de transportes o de la gestión de la energía pueden tener efectos catastróficos.

En resumen, la IA presenta cuatro grandes tipos de riesgo que deben ser abordados y controlados: el riesgo existencial, el relacionado con las transformaciones sociales y económicas, su incidencia en los conflictos militares y la pérdida de autonomía humana.

La esperanza es que los gobiernos e instituciones intencionales sean capaces de encontrar remedio, si bien, si observamos cómo han ido muchos aspectos que puedan servir como precedente, la confianza con que esta esperanza se haga realidad es modesta. Basta con ver cómo el teléfono móvil se ha convertido en una dependencia. O la extensión generalizada de la droga. También la dificultad de poner puertas al mercado, cuando existe una expectativa de beneficio alguien entra en zona de riesgo para conseguirla realizar. También la pugna entre potencias y, en último término, la gran cuestión: dónde está el imperativo moral que permita canalizar para bien la IA. En el armamento nuclear existe por negativa. Es el riesgo de la destrucción mutua, pero en la IA quien se salte la norma por una ventaja determinada puede pensar que el daño sólo será para los demás. Detrás del problema, como de tantos otros que sufre nuestra sociedad, lo que late es una crisis moral.