Sí, no se trata de ciencia ficción. Los dos mayores peligros presentes en la actualidad son: el más conocido el de la Inteligencia Artificial y el menos tratado el de la capacidad para leer la mente de las personas.

Dos noticias han coincidido ahora mismo en alertarnos sobre este hecho. Por un lado, la escandalosa dimisión de Geoffrey Hilton llamado “el padrino” de la IA, que abandona su importante sitio en Google para, como según él mismo declara, hablar con libertad de los peligros de la IA. Y dice cosas tan preocupantes como que «no seremos capaces de saber qué es verdad» y «es difícil ver cómo se puede evitar que los malos actores utilicen la tecnología para cosas horribles».

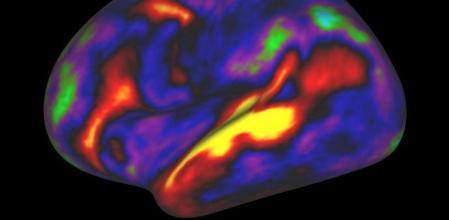

La otra información señala que científicos de EE.UU., concretamente de la universidad de Texas en Austin, ya han conseguido aplicaciones prácticas de la resonancia magnética para indagar qué está pensando aquella persona en un determinado momento. Este trabajo va vinculado a un complemento de modelo lingüístico GPT de IA que al mismo tiempo evalúa cuál es la palabra más probable que viene a continuación en relación a las imágenes de activación cerebral que la resonancia magnética va generando.

Es evidente que este avance, como la IA, puede producir ventajas muy notables, sobre todo en el campo de la medicina, pero también lo es que a partir de ese momento la privacidad mental se verá claramente amenazada.

La combinación de estos dos elementos, IA y lectura de la actividad cerebral, creará grandes problemas porque permitirá vulnerar la privacidad y la intimidad exponiendo los pensamientos, emociones y recuerdos a terceros no autorizados. Podría ser utilizada también para controlar, influenciar o coaccionar a las personas violando su primigenia libertad. Si ahora ya lo intentan de todas las formas posibles en el ámbito del consumo y la política electoral, utilizando técnicas y metodologías motivacionales, imagínense lo que puede significar, tan revolucionario como es, poder interpretar directamente lo que la gente piensa.

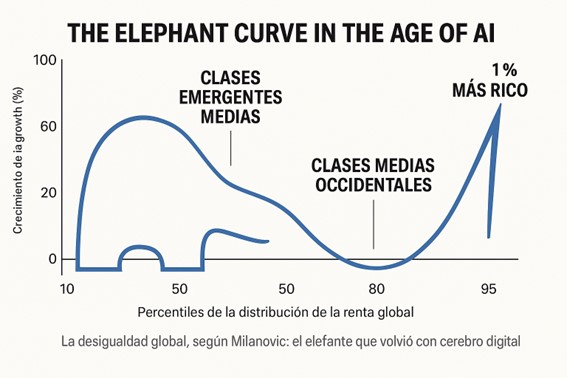

Si a este hecho se le une la evidencia de que a través de nuestro acceso a internet ya están registrados todos nuestros intereses, preferencias, odios y necesidades, si a este factor le añade la capacidad actual para trabajar el big data, verá que estamos al borde de una sociedad alienada absolutamente por el poder, sea político, económico o mediático.

Todos estos problemas se añaden a los que ya de por sí conocemos de la IA: la confusión entre lo que es verdad y lo que no, los cambios radicales en la forma de educar, cómo enseñar y qué enseñar hoy en día, porque ésta es cuestión crítica. Y el riesgo de que la IA más la adicción que ya existe a las pantallas reduzca más la capacidad de leer y también de escribir, limitando de este modo nuestro desarrollo cognitivo. Hoy en día es una evidencia de que la lectura facilita el desarrollo de las capacidades intelectuales de una persona y no puede ser sustituida por otras vías de entrada como pueden ser las imágenes.

El hecho de que sirve de información y contrainformación, puedan acceder, ya disponen de parte de estas tecnologías, significa una vigilancia de cuya sombra no estamos protegidos. Si ni siquiera el gobierno es capaz de explicar qué ha pasado con un solo programa informático como el Pegasus, capaz de captar la información de los móviles, ya me dirá qué capacidad de respuesta tendrán cuando hemos entrado rápidamente en escenarios mucho más complejos como las diversas aplicaciones de la IA y sus conexiones con la lectura mental.

Urge una regulación mundial sobre esta materia sin que esto signifique que el problema está resuelto, porque es evidente que hecha la ley hecha la trampa. Y mientras esto no llega, la UE y los Estados miembro deben regular sobre esta materia. Por ejemplo, el gobierno Meloni en Italia ya lo ha hecho con ChatGPT. Es un camino que hay que seguir para garantizar que su uso no pone en riesgo nuestra privacidad. Un paso adelante en este sentido es que la UNESCO ha elaborado una serie de recomendaciones sobre la ética de la IA y ha publicado una guía para su uso en la educación. Es un paso en buen sentido, pero abiertamente insuficiente.