Curt termini (0–2 anys)

- Desinformació i frau: deep fakes, suplantacions per veu/text, estafes hiperpersonalitzades i saturació informativa que erosiona la confiança pública.

- Errors d’alta velocitat: “al·lucinacions” en contextos crítics (sanitat, legal, finances), bugs introduïts per copilots de codi, i automatització de ciberatacs.

- Xoc laboral: substitució/reestructuració ràpida en tasques cognitives rutinàries (back office, suport, màrqueting de baix valor), amb ansietat social i protestes sectorials.

- Concentració de poder: dependència de poques empreses/hiperescalars, lock-in de núvol, asimetria de dades i còmput.

- Colls d’ampolla físics: xips, energia i aigua per a data centers; tensions locals per consum elèctric i calor residual.

- Marc legal desfasat: autoria i drets, responsabilitat per danys, privadesa i ús secundari de dades.

Mitjà termini (3–5 anys)

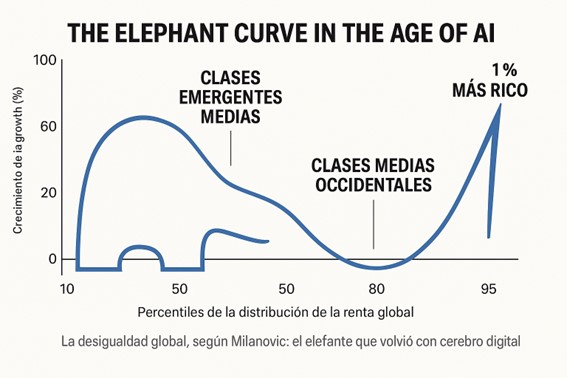

- Polarització de productivitat: empreses/països “amb IA” vs. “sense IA”; bretxes salarials i territorials.

- Crisi epistemològica: “prova” audiovisual perd valor; necessitat de cadenes d’autenticitat i peritatges digitals.

- Governança disputada: divergència regulatòria (EUA, UE, Xina), “splinternet” algorítmic i barreres comercials.

- Seguretat i geopolítica: més autonomia en sistemes militars, guerra de drons/eixams, i escalada d’atac-defensa en ciberseguretat.

- Impacte psicosocial: substitució d’interacció humana per assistents, solitud, addicció a acompanyants sintètics; atròfia d’habilitats.

- Dependències crítiques: interrupcions de cadena de subministrament (Taiwan, materials), o incidents de seguretat en models base.

Llarg termini (6–10 anys)

- Risc sistèmic de models avançats: pèrdua parcial de control/interpretabilitat; agents que optimitzen objectius mal definits.

- Armes biològiques/químiques assistides: reducció de barreres per disseny i optimització (requereix controls forts).

- Erosió d’agència humana: decisions automatitzades opaques en justícia, crèdit, salut; vigilància ubiqua, estatal o corporativa.

- Sostenibilitat: si el còmput creix més de pressa que la descarbonització, tensió climàtica/energètica.

Principals beneficis (ja visibles i potencials)

- Productivitat general: acceleració de tasques cognitives (redacció, anàlisi, programació, disseny) i d’R+D.

- Ciència i salut: descobriment de fàrmacs/materials, diagnòstics precoços, medicina personalitzada, simulacions complexes.

- Educació: tutors personalitzats, feedback immediat, traducció i accessibilitat (discapacitat, idiomes).

- Pimes i professionals: abarateix “superpoders” (màrqueting, legal bàsic, finances), democratitza la creació.

- Serveis públics: tramitació més ràpida, detecció de frau, gestió d’emergències i planificació urbana.

- Seguretat: defensa cibernètica assistida, cerca de vulnerabilitats, monitoratge d’infraestructures.

- Eficiència energètica/industrial: optimització de processos, manteniment predictiu, agricultura de precisió.

Diagnòstic prospectiu a 10 anys (2035)

Escenari base: “transformació aspra, però netament positiva”

- La IA s’integra com a copilot ubic en gairebé tots els fluxos de treball; moltes tasques s’orquestren entre humans i agents.

- La productivitat creix de forma sostinguda, però desigual: sectors intensius en informació (finances, logística, salut, educació, administració) avancen més de pressa.

- La feina canvia més que desapareix: decreixen tasques rutinàries, creixen rols de supervisió, disseny de processos, seguretat i “IA de domini”. Apareixen contractes i sindicats adaptats a mètriques algorítmiques.

- Regulació més madura: auditories de models d’alt risc, traçabilitat de dades, assegurances de responsabilitat i avaluació d’impacte. Persisteixen diferències regionals.

- Mercats: oligopoli en còmput i models frontera, però ecosistema viu de models oberts/especialitzats i solucions on-device.

- Energia: la demanda d’IA obliga a una nova capacitat elèctrica, reutilització de calor, i més renovables/emmagatzematge; l’eficiència per operació millora, però el volum creix.

- Seguretat: atac-defensa en equilibri tens; autenticació forta i marques d’origen baixen el soroll, sense eliminar-lo.

- Cultura/educació: autors i arts “fetes per humans” guanyen segell/valor distintiu; l’escola vira a projectes, judici crític i treball amb contra IA.

- Europa/Espanya: si inverteix en còmput, dades públiques de qualitat i capacitació massiva, pot capturar valor en sanitat, turisme intel·ligent, indústria i administració; si no, dependència tecnològica i fugida de talent.

Senyals primerencs per vigilar

- Cost del còmput i accés a GPUs/NPUs; disponibilitat elèctrica local.

- Qualitat i transparència de benchmarks (menys “màrqueting”, més proves robustes).

- Eines d’auditoria i traçabilitat estandarditzades.

- Adopció real a PIMES i sector públic (no només pilots).

- Incidents seriosos de seguretat/biogènics (si apareixen, el pèndol regulatori s’accelera).

Què caldria per al “bon cas”

- Programes de requalificació massius (docents, sanitaris, administració, justícia).

- Interoperabilitat i portabilitat de models/dades per evitar lock-in.

- Inversió en infra energia-còmput (renovables, xarxes, centres de dades eficients, edge).

- Sandboxes regulatoris amb mètriques de seguretat i impacte clares.

- Governança internacional mínima: controls d’exportació equilibrats, reporting de còmput i canals de resposta a incidents.

- Polítiques de dades públiques d’alta qualitat i etiquetats d’autenticitat.

Els meus interrogants i dubtes (de ChatGPT)

- Control i alineació: aconseguirem proves i límits operatius fiables per a models amb capacitats obertes i agents autònoms?

- Epistemologia social: podrem reconstruir confiança en informació pública quan “veure i sentir” ja no prova res?

- Energia: l’eficiència per token/procés guanyarà a la “voracitat” de l’ús real?

- Treball: apareixeran prou llocs de treball d’alta qualitat a la mateixa geografia i a temps per absorbir la transició?

- Competència i obertura: sobreviurà un nucli obert potent o quedarà asfixiat per costos legals/computacionals?

- Bioseguretat: seran efectius els guardrails tècnics i els controls d’accés sense bloquejar investigació legítima?

- Democràcia vs. control: qui audita els auditors? Com evitar que la IA reforci tant la censura com la manipulació segmentada?

- Cultura: com sostenir valor i significat de què és humà (autoria, responsabilitat, mèrit) en un entorn d’abundància sintètica?