Sí, no es tracta de ciència-ficció. Els dos perills més grans presents en l’actualitat són: el més conegut el de la Intel·ligència Artificial i el menys tractat el de la capacitat per llegir la ment de les persones.

Dues notícies han coincidit ara mateix per alertar-nos sobre aquest fet. D’una banda, l’escandalosa dimissió de Geoffrey Hilton anomenant “el padrí” de la IA, que abandona el seu important lloc a Google per, com segons ell mateix declara, parlar amb llibertat dels perills de la IA. I diu coses tan preocupants com que “no serem capaços de saber que és veritat” i “és difícil veure com es pot evitar que els mals actors facin servir la tecnologia per a coses horribles”.

L’altra informació assenyala que científics dels EUA, concretament de la universitat de Texas a Austin, ja han aconseguit aplicacions pràctiques de la ressonància magnètica per indagar què està pensant aquella persona en un determinat moment. Aquest treball va vinculat a un complement de model lingüístic GPT d’IA que al mateix temps avalua quina és la paraula més probable que ve a continuació en relació amb les imatges d’activació cerebral que la ressonància magnètica va generant.

És evident que aquest avenç, com la IA, pot produir avantatges molt notables, sobretot en el camp de la medicina, però també ho és que a partir d’aquest moment la privacitat mental es veurà clarament amenaçada.

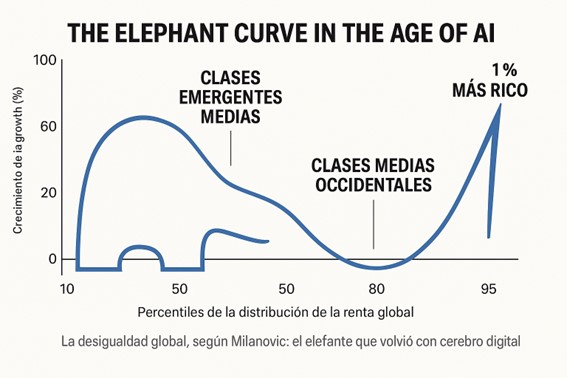

La combinació d’aquests dos elements, IA i lectura de l’activitat cerebral, crearà grans problemes perquè permetrà vulnerar la privacitat i la intimitat exposant els pensaments, les emocions i els records a tercers no autoritzats. Podria ser utilitzada també per controlar, influenciar o coaccionar a les persones violant la seva llibertat primigènia. Si ara ja ho intenten de totes les maneres possibles en l’àmbit del consum i la política electoral, fent servir tècniques i metodologies motivacionals, imagineu-vos què pot significar, tan revolucionari com és, poder interpretar directament el que la gent pensa.

Si a aquest fet se li uneix l’evidència que a través del nostre accés a internet ja hi ha registrats tots els nostres interessos, preferències, odis i necessitats, si a aquest factor li afegiu la capacitat actual per treballar el big data, veureu que estem a un pas d’una societat alienada absolutament pel poder, sigui polític econòmic o mediàtic.

Tots aquests problemes s’afegeixen als que ja de per sí coneixem de la IA: la confusió amb el què és veritat i el què no, els canvis radicals en la forma d’educar, com ensenyar i què ensenyar avui en dia perquè aquesta és una qüestió crítica. El risc que la IA més l’addicció que ja existeix a les pantalles redueixi més la capacitat de llegir i també d’escriure, limitant d’aquesta manera el nostre desenvolupament cognitiu. Avui en dia és una evidència que la lectura facilita el desenvolupament de les capacitats intel·lectuals d’una persona i no pot ser substituïda per altres vies d’entrada com poden ser les imatges.

El fet que serveix d’informació i contrainformació, puguin accedir, ja disposen de part d’aquestes tecnologies, significa una vigilància en l’ombra de la qual no estem protegits. Si ni tan sols el govern és capaç d’explicar què ha passat amb un sol programa informàtic com el Pegasus, capaç de captar la informació dels mòbils, ja em direu quina capacitat de resposta tindran quan hem entrat ràpidament a escenaris molt més complexos com les diverses aplicacions de la IA i les seves connexions amb la lectura mental.

És urgent una regulació mundial sobre aquesta matèria sense que això signifiqui que el problema està resolt, perquè és evident que feta la llei feta la trampa. I mentre això no arriba, la UE i els estats membres han de regular sobre aquesta matèria. Per exemple, el govern Meloni a Italia ja ho ha fet amb el ChatGPT. És un camí que cal seguir per garantir que el seu ús no posa en risc la nostra privacitat. Un pas endavant en aquest sentit és que la UNESCO ha elaborat una sèrie de recomanacions sobre l’ètica de la IA i ha publicat una guia per al seu ús en l’educació. És un pas en el bon sentit però obertament insuficient.